現代の高度化する機械システムにおいて、周囲の動的な環境をリアルタイムかつ三次元で正確に把握する能力は、技術的な要だ。自動運転車が複雑な交差点を安全にナビゲートするためにも、自律型ドローンが未知の空間を飛行するためにも、あるいは高度な拡張現実(AR)デバイスが現実世界と仮想情報を違和感なく融合させるためにも、外界を認識する「眼」の性能がそのシステムの限界を決定づける。

2026年3月12日、科学誌『Nature』に、この領域で大きなブレークスルーをもたらす画期的な論文「A large-scale coherent 4D imaging sensor」が掲載された。研究チームは、空間の三次元構造を極めて詳細にマッピングすると同時に、そこにあるあらゆる物体の「速度」という第4の次元を瞬時に捉えることができる超小型の4Dイメージングセンサーを開発したのだ。特筆すべきは、この複雑極まりない光学処理と信号処理のすべてが、ミリメートル単位の単一のシリコンチップ上に完全に統合されているという点である。

本稿では、従来の3Dセンサーが抱えていた物理的な限界から解き明かし、新たに登場したこの「究極のセンサー」の技術的本質と、それがもたらす波及効果について見ていきたい。

従来の3Dセンサーが直面していた物理的・構造的な限界

機械に三次元の視覚を与えるための技術として、これまでLiDAR(Light Detection and Ranging:光検出と測距)システムが広く研究および実用化されてきた。現在、消費者向け電子機器や自動車産業において主流となっているのは、ToF(Time-of-Flight:飛行時間)方式と呼ばれるLiDAR技術である。

ToF方式のジレンマ:パルスエネルギーとスキャン機構の代償

ToF方式の原理は直感的に理解しやすい。レーザーからごく短い光のパルスを対象物に向けて発射し、それが反射してセンサーに戻ってくるまでの時間を計測することで、光の速度を基に対象物までの距離を算出する。スマートフォンのカメラアプリなどで使用される近距離の深度測定においては、この方式は低消費電力かつコンパクトな設計が可能であり、十分な成果を上げている。

しかし、このシステムを自動運転車が必要とするような数百メートル先の対象物を検知する長距離アプリケーションにスケールアップしようとすると、深刻なジレンマに直面する。遠くの対象物から十分な反射光を得るためには、照射する光パルスのエネルギーをマイクロジュール(μJ)のレベルまで引き上げる必要があるのだ。これにより、システム全体の消費電力が激増するだけでなく、目を保護するための安全基準(アイセーフティ)を満たすことが難しくなる。さらに、広い視野角(FOV)を確保するためには、レーザー光を物理的なミラーで振り回す機械的なスキャン機構が不可欠となる。可動部を持つシステムはサイズが大型化し、製造コストが跳ね上がるだけでなく、車両の振動に対する機械的な安定性や耐久性が著しく低下するという構造的な弱点を抱えている。

光フェーズドアレイ(OPA)の限界と「速度」計測の欠如

こうした可動部の問題を解決するため、機械的な動きを伴わずに光のビームを操るソリッドステート(完全電子式)の技術として、光フェーズドアレイ(OPA:Optical Phased Array)技術の研究が進められてきた。これは、微小なアンテナから発せられる光の位相を個別に制御することで、光の干渉を利用してビームの方向を曲げる技術である。しかし、OPA方式においても、長距離測定、高解像度、そして低消費電力という三つの要件を同時に満たすことは技術的に極めて困難であった。外部の光学系に頼らずに広い視野角を達成することは依然として課題であり、何より数千もの発光素子の位相を精密に調整し続けるためのキャリブレーション手法の確立が壁となっていた。

そして、従来のToF方式やOPA方式に共通する最大の弱点は、移動する物体の「速度」を直接かつ瞬時に測定できないことである。対象物の速度を知るためには、異なる時間で取得した複数の三次元フレームを比較演算する必要があり、処理の遅延(レイテンシ)が生じる。1秒間に数十メートルを進む自動運転の世界では、このわずかな遅延が致命的な事故に直結する可能性がある。

第4の次元「速度」を捉えるFMCW LiDARの革新性

これらの限界を一掃するブレイクスルーとして登場したのが、今回発表されたチップが採用している「FMCW(Frequency-Modulated Continuous-Wave:周波数変調連続波)LiDAR」という技術である。FMCWは、光の波としての性質を極限まで活用し、距離と速度を一つのプロセスで同時に抽出するエレガントな手法だ。

チャープ信号とビート周波数が距離を暴く

FMCW方式では、ToF方式のような断続的な光のパルスは使用しない。代わりに、周波数が時間とともに連続的かつ直線的に変化する連続波のレーザー光(チャープ信号と呼ばれる)を照射する。照射された光の一部はセンサー内で「ローカルオシレーター(LO)」と呼ばれる参照光として保持され、残りの光が対象物へと向かう。

対象物で反射して戻ってきた光は、センサー内で保持されていたLO光と重ね合わせられる(コヒーレント検出)。光が対象物までの間を往復している間に、レーザー光源の発する周波数はすでに変化しているため、戻ってきた反射光と現在のLO光との間にはわずかな「周波数のズレ」が生じている。この異なる周波数の波が重なり合うと、波の干渉によって「うなり(ビート)」が発生する。このビート周波数は、光が往復に要した時間、すなわち対象物までの距離に正確に比例する。対象物が遠ければ遠いほど周波数のズレは大きくなり、ビート周波数は高くなるという単純かつ強固な物理法則を利用しているのだ。

光のドップラー効果による瞬時の速度抽出

さらにFMCWが真価を発揮するのは、対象物が移動している場合である。救急車のサイレンが近づくときは音が高く聞こえ、遠ざかるときは低く聞こえるのと同じように、光の世界でも「ドップラー効果」が発生する。対象物がセンサーに向かって動いている場合、反射して戻ってくる光の波長は圧縮されて周波数が高くなり、遠ざかっている場合は周波数が低くなる。

研究チームは、周波数が直線的に上昇する波(アップチャープ:32マイクロ秒)と、直線的に下降する波(ダウンチャープ:32マイクロ秒)を連続して照射する手法を採用した。もし対象物が静止していれば、アップチャープ時とダウンチャープ時に観測されるビート周波数は等しくなる。しかし、対象物が移動している場合、ドップラーシフトによって一方のビート周波数は高く、もう一方は低く観測される。この二つのビート周波数の差分を計算することで、計算上の遅延をほとんど伴わずに、対象物の視線方向の速度(動径速度)を直接かつ超高精度で割り出すことができるのだ。

60万超のコンポーネントを統合した究極のアーキテクチャ

FMCW LiDARの理論自体は古くから知られていたが、それを実用的な解像度を持つコンパクトなセンサーとして実現することは、製造プロセス上の巨大な挑戦であった。極めて繊細な光学回路と、それを処理する電子回路を大規模に集積する必要があるためだ。今回、Pointcloud GmbHなどの研究チームは、標準的なCMOS製造プロセスを拡張したシリコンフォトニクス技術を駆使し、この難題を克服した。

大規模焦点面アレイ(FPA)のモノリシック統合

開発された4Dイメージングチップの中核をなすのは、352×176ピクセル、合計61,952個ものピクセルが配置された焦点面アレイ(FPA:Focal Plane Array)である。これは、過去に報告された最先端のFMCW FPAと比較して、ピクセル数が一挙に5倍に跳ね上がった画期的な規模である。デジタルカメラのCMOSイメージセンサーに匹敵する、QVGA(四半VGA)に近い解像度を単一の光学チップで実現したことになる。

驚くべきは、この小さなシリコン基板上に、60万個を超えるフォトニックコンポーネント(光回路部品)と、それらを制御・信号処理するためのCMOS電子回路が「モノリシック統合(一体成型)」されている点だ。別々のチップを製造して後から貼り合わせるのではなく、単一の製造プロセスで光と電子の回路を同時に作り込むことで、部品間の配線遅延や歩留まりの悪化を防ぎ、圧倒的なコスト競争力と信頼性を確保している。

モノスタティック構成:送受信の一体化によるクロストークの排除

チップ上の各ピクセルの設計において、研究チームは「モノスタティック構成」というアプローチを採用した。従来の多くのシステム(バイスタティック構成)では、光を送信する素子と反射光を受信する素子が別々に配置されていた。しかしこの方式では、送信ピクセルと受信ピクセルのペアを正確に合わせるための複雑な光学アライメントが必要となり、アレイの規模が大きくなるほど設計が困難になっていた。

今回のチップでは、各ピクセルに組み込まれた回折格子(グレーティングカプラ)が、変調された光を空間へ送り出すアンテナの役割と、対象物から散乱して戻ってきた微弱な光を捉える受信器の役割の両方を単独で果たす。受信された光は、ピクセル内に設けられた方向性結合器(50/50カプラー)を通じて直ちにローカルオシレーター(LO)光と混合され、バランスド・ゲルマニウムPIN光検出器へと送られる。この設計により、隣接するピクセル間で光が漏れるクロストーク問題が物理的に排除されるとともに、システム全体で必要となるイメージングレンズがたった一つで済むという劇的な簡素化を達成した。

チップ上のトランスインピーダンスアンプ(TIA)によるノイズ極小化

微小な光検出器で発生したビート周波数の電気信号(光電流)は、きわめて微弱である。これを長い配線でチップの外に引き出そうとすれば、環境ノイズに埋もれてしまい、使い物にならなくなる。これを防ぐため、研究チームは各ピクセルの直下にトランスインピーダンスアンプ(TIA)と呼ばれる電流-電圧変換増幅回路を配置した。

光が検出されたその瞬間、その場で直ちに電気信号が増幅されるため、ノイズの混入を最小限に抑えつつ、チップ外のA/D(アナログ-デジタル)コンバータへと信号を伝送することが可能となった。FMCWにおけるコヒーレント検出は、発射した光と位相が揃っている(コヒーレントな)反射光のみを検出するため、太陽光などの外部からの強い干渉光に対しても極めて高い耐性を持つ。

階層化された熱光学スイッチネットワークによるビームステアリング

6万以上のピクセルすべてに同時に光を供給し、信号を読み出すことは、電力と発熱の観点から現実的ではない。そこで採用されたのが、完全電子制御によるビームステアリング(走査)機構である。チップの外部には波長1310nmのレーザー光源があり、そこから周波数変調された光が16本の光ファイバーを通じてチップに入力される。

チップ上には、熱を加えることで光の屈折率を変化させ、光の経路を切り替える「熱光学スイッチ(Thermo-optic switch)」が大規模なツリー構造をなして張り巡らされている。このスイッチングネットワークは2段階の階層構造を持っており、最初のステージで特定のブロックへ光を導き、次のステージでブロック内の特定のピクセル行(8ピクセル単位)へと光を分配する。可動部を一切持たないこのソリッドステート方式により、チップはミリ秒単位の極めて高速な速度で、対象物のどの部分をスキャンするかを電子的に切り替えることができる。

実証された驚異の4Dマッピング性能

研究チームは、製造されたセンサーチップに市販の短波長赤外線(SWIR)レンズを取り付け、実際の環境下での性能評価を実施した。その結果は、この技術がすでに商用化の要件を満たすレベルに達していることを明確に示している。

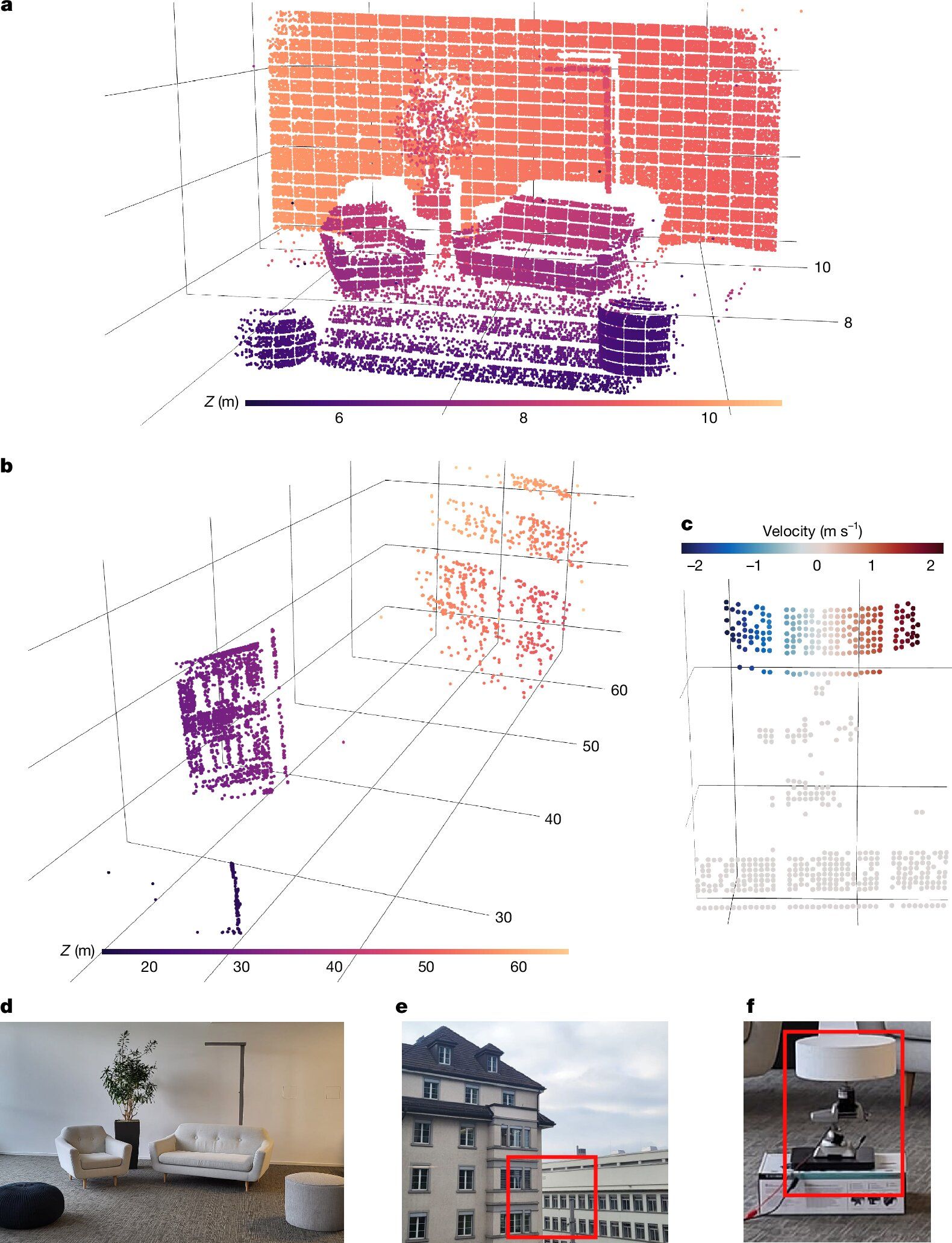

65m先の建築ディテールを数ナノジュールで描画

屋外での実験では、センサーから65メートル以上離れた場所にある建物をターゲットとした。結果として得られた3D点群データは、窓枠やバルコニーの形状、建物のファサードのテクスチャに至るまで、驚くほど鮮明に解像されていた。使用されたレンズの焦点距離は50mmであり、この構成においてシステムは23.11° × 13.55°の視野角と、0.06°という極めて高い角度分解能を達成した。

さらに重要なのは、この長距離マッピングが、1ピクセルあたりわずか46ナノジュール(nJ)という極小の光学エネルギーで実行されたことだ。これは、ToF方式のLiDARが同等の距離を測定する際に必要とするエネルギー(数マイクロジュール)の数十分の一から数百分の一に相当する。チップ内のローカルオシレーターと受信信号を干渉させる手法により、受信感度が飛躍的に向上しているためだ。

高速回転ディスクによる「速度」のリアルタイム可視化

「4D」という名称の真骨頂は、速度のリアルタイム測定にある。これを実証するため、チームはセンサーから6メートル離れた位置に、垂直軸を中心に高速で回転するディスクを配置した。

取得された点群データには、単なるディスクの三次元形状だけでなく、ピクセルごとに異なる速度情報が付与されていた。ディスクの手前に向かって回転してくる部分はプラスの速度として、奥へ遠ざかっていく部分はマイナスの速度として、明確なグラデーションをもって可視化されたのだ。速度の誤差はわずか秒速3.0ミリメートル(σ=3.0 mm/s)に抑えられており、自動運転車が歩行者の微細な動きや対向車の速度変化を瞬時に読み取るための能力が十分に備わっていることが証明された。

フレームレートと信号処理のスケーラビリティ

現在、市販の評価ボードを用いた実験セットアップでは、8ピクセルの並列読み出しにより、1秒間に1回シーンを更新する1fps(フレーム/秒)の動作が確認されている。しかしチップ自体は、16チャンネルの同時入力と128出力信号の同時読み出しをサポートするよう設計されており、1ピクセルあたり130マイクロ秒の読み出し時間で処理を進めれば、将来的には最大15fpsでのリアルタイムな高解像度動画マッピングが十分に可能であると論文は結論づけている。

光学の物理限界を突破する今後の展望

今回の発表は、3Dセンサーの歴史における劇的なマイルストーンであるが、研究チームの視座はすでにその先を見据えている。FMCWシステムの性能を究極的に左右するのは、いかにして「ショットノイズ限界(光子の量子的な揺らぎに由来する回避不可能なノイズの壁)」に到達するかという点にある。

現在のチップでは、TIA(アンプ)から発生する熱ノイズが支配的であり、完全なショットノイズ限界からは約5.6デシベル(dB)の感度ペナルティが生じていることが示された。次世代のチップでは、ピクセル設計をわずかに変更し、ローカルオシレーター(LO)の光パワーを最適化することで、このペナルティを容易に取り除くことができる。

さらに、強力な性能向上をもたらす切り札として提案されているのが、従来のシリコン(Si)導波路に代わる、新たな材料アーキテクチャの導入である。現状では、シリコン導波路特有の「二光子吸収」や「自由キャリア吸収」といった非線形光学効果が原因となり、チップ内に導入できる光の最大パワーが16mW程度に制限されている。これを、光の吸収損失が極めて少ないシリコンナイトライド(SiN)素材とハイブリッド統合する「Si-SiNブレンドアーキテクチャ」へと進化させることで、単一ピクセルに供給できる光パワーを10倍以上に引き上げることが可能となる。これにより、ノイズ限界の克服と相まって、センサーの有効探知距離は200メートルを優に超えることが確実視されている。

4Dイメージングが書き換える未来の地図

Pointcloud GmbHなどの研究チームが今回提示した「大規模コヒーレント4Dイメージングセンサー」は、単なるLiDAR技術の改良ではない。それは、複雑な光学レンズ群や機械的な駆動部を必要とした従来の巨大なセンサーシステムを、完全に電子化され、半導体工場で大量生産可能な「単一の小さなチップ」へと還元したという点で、かつて真空管がトランジスタに、そして集積回路(IC)へと進化した歴史的転換に匹敵する偉業である。

CMOSイメージセンサーの普及によって、誰もがポケットの中に高画質なデジタルカメラを持ち運べるようになったように、この技術は三次元の空間認識技術のコスト構造を根底から破壊し、あらゆるデバイスに普及させる「民主化」の鍵となる。

天候や夜間という条件に左右されず、周囲のすべての物体の正確な位置と速度を同時に捉える自動運転車。入り組んだ都市空間を超低消費電力で安全に自律飛行する配達ドローン。あるいは、現実空間の奥行きや動的な変化をミリメートル単位で認識し、バーチャルなオブジェクトを寸分の狂いもなく現実世界に重畳させる次世代のARグラス。この単一チップ上の「眼」は、機械と人間のインタラクションをかつてないレベルへと引き上げ、私たちの世界観そのものをアップデートする原動力となるだろう。

論文

参考文献